-

- AI创新应用CoPaw它支持本地/云端双部署,可无缝连接主流聊天应用,同时运行本地大语言模型,彻底摆脱云服务依赖。

爱站权重:

CoPaw是基于AgentScope框架构建的开源AI助理工作站,核心定位为全隐私可控的个人智能协作中枢。它支持本地/云端双部署,可无缝连接主流聊天应用,同时运行本地大语言模型,彻底摆脱云服务依赖。产品采用Python+TypeScript混合架构,实现核心模块解耦,支持灵活扩展与个性化定制,精准助力用户搭建自动化工作流程,全面提升工作与生活效率。作为开源项目,CoPaw全程免费使用,无任何付费增值限制,是追求隐私与效率平衡用户的理想选择。

CoPaw核心功能:

1、多渠道聊天原生集成:

无缝连接钉钉、飞书、QQ、Discord、iMessage等主流聊天应用,通过统一渠道协议保障各平台行为一致、消息可靠传递,让用户在任意沟通场景都能便捷调用AI助理。

2、本地模型隐私可控:

支持在本地机器独立运行大语言模型,无需API密钥、无云依赖,完美兼容llama.cpp(跨平台)与MLX(苹果Silicon M1-M4),彻底保障用户数据隐私与自主控制权。

3、模块化解耦架构:

代理核心采用模块化设计,提示钩子、工具调用、内存系统等组件完全解耦。开发者可独立替换、扩展任一模块,自由组装个性化AI代理,适配不同使用场景。

4、可扩展技能系统:

内置定时调度功能与自定义技能体系,技能可从用户工作空间自动加载;支持通过命令行界面创建、安装/移除技能,避免供应商锁定,灵活拓展AI助理能力。

5、长期记忆+自主任务执行:

借助长期记忆系统,主动记住用户决策、偏好、待办事项;创新心跳机制支持自主执行预定任务(邮件检查、报告编译、待办事项提醒等),无需手动干预,实现自动化协作。

6、统一消息队列保障:

内置消息消费与队列机制,确保多渠道并行消息处理零丢失、高可靠,即使高负载场景下仍能维持稳定消息流转,保障服务连续性。

7、统一模型管理层:

提供统一模型调度层,兼容云API(通义千问等主流模型)、自托管推理服务(Ollama、llama.cpp)及苹果Silicon本地执行(MLX),用户可根据算力、隐私需求灵活选择模型底座。

CoPaw使用教程:

1、选择部署方式:

根据自身环境选择适配方案,快速完成部署:

- pip 安装(Python 3.10+):执行 pip install copaw;

- 一键脚本安装:通过 curl -fsSL https://copaw.agentscope.io/install.sh | bash 自动配置Python环境;

- 容器化部署:采用 Docker 进行容器化部署;

- 云部署:在 ModelScope Studio 或阿里云计算巢一键部署。

2、初始化与启动应用:

安装完成后,执行 copaw init --defaults 完成初始化,再使用 copaw app 启动CoPaw应用。

3、访问管理控制台:

在浏览器打开 http://127.0.0.1:8088,进入CoPaw可视化控制台,进行后续配置。

4、个性化配置与使用:

- 连接常用聊天应用(钉钉、飞书等);

- 选择适配的大语言模型(本地/云API均可);

- 利用内置技能、定时调度功能,搭建专属自动化工作流程,解锁办公、创作、开发全场景效率提升。

数据统计

特别声明&浏览提醒

本站AI工具导航站提供的「CoPaw」的相关内容都来源于网络,不保证外部链接的准确性和完整性。在2026年03月11日 20时52分16秒收录时,该网站上的内容都属于合规合法,后期网站的内容如出现违规,可以直接联系网站管理员(ai@ipkd.cn)进行删除,AI工具导航站不承担任何责任。在浏览网页时,请注意您的账号和财产安全,切勿轻信网上广告!

7款免费AI英语口语软件,一对一模拟对话,轻松开口说英语!

7款免费AI英语口语软件,一对一模拟对话,轻松开口说英语! 12款AI生成PPT的工具和网站,快速打造精美演示文稿

12款AI生成PPT的工具和网站,快速打造精美演示文稿 亚马逊全球网点布局大盘点(包括所有开店流程)

亚马逊全球网点布局大盘点(包括所有开店流程) 多款免费AI声音克隆工具,精准复刻音色,你也可以当主播

多款免费AI声音克隆工具,精准复刻音色,你也可以当主播 打工人开工的12款办公室ai工具

打工人开工的12款办公室ai工具 盘点8个欧美电影免费观看电视剧大全

盘点8个欧美电影免费观看电视剧大全 几款免费AI 3D模型生成工具,快速制作逼真三维模型!

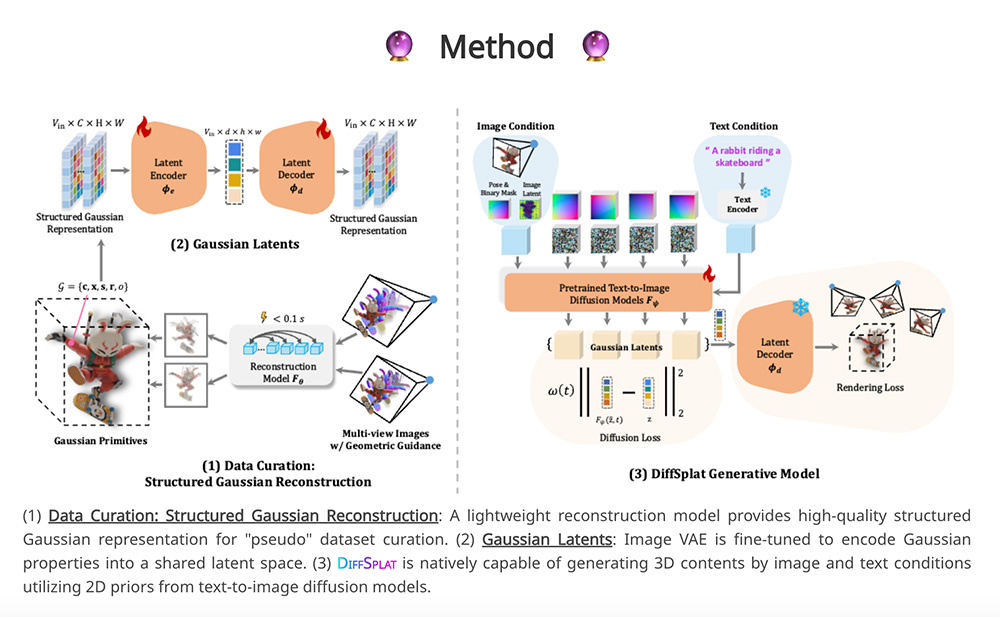

几款免费AI 3D模型生成工具,快速制作逼真三维模型! 几款免费AI绘图工具,一键生成流程图与办公图表

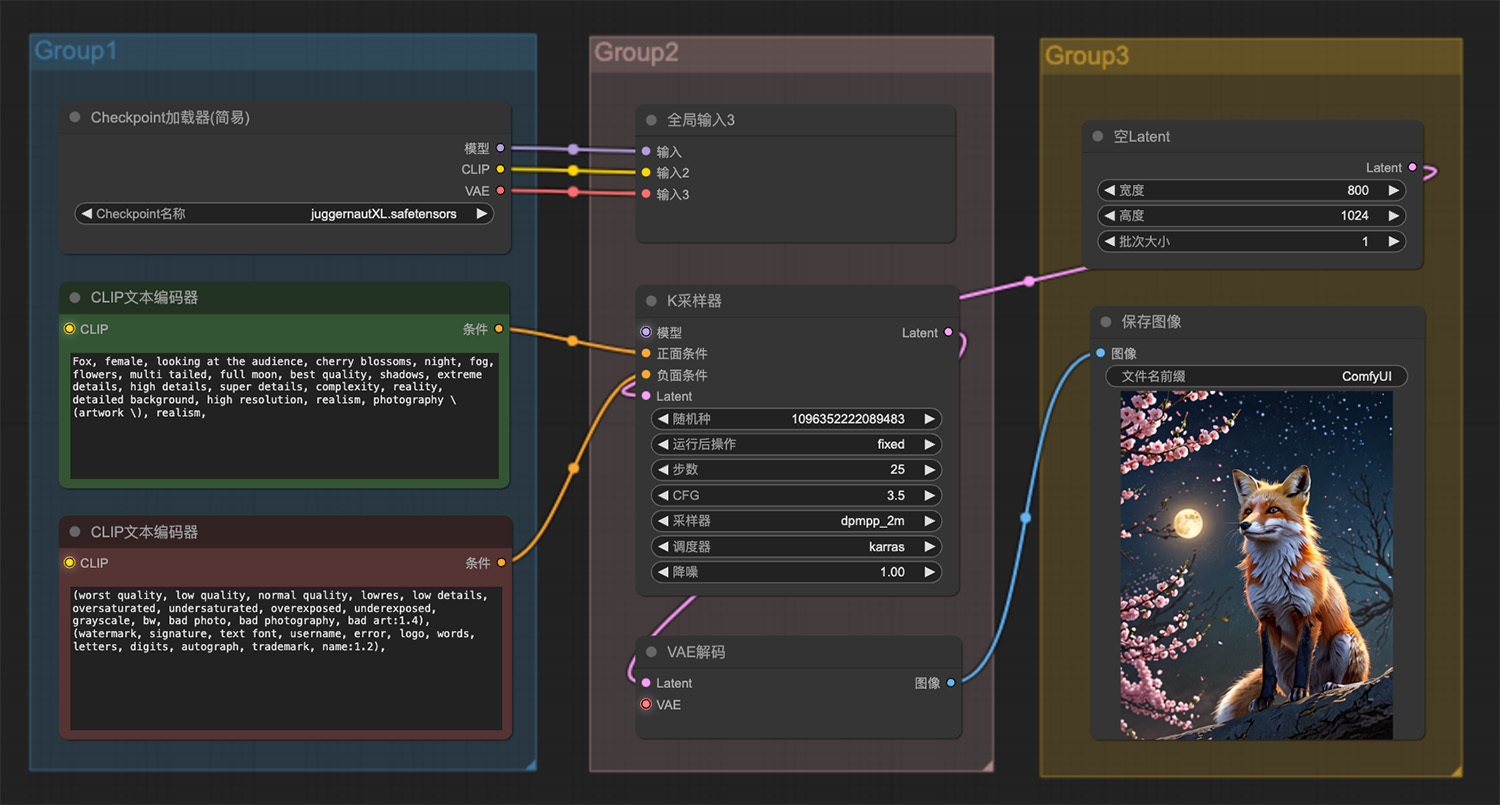

几款免费AI绘图工具,一键生成流程图与办公图表 晚上樱花狐狸ComfyUI工作流

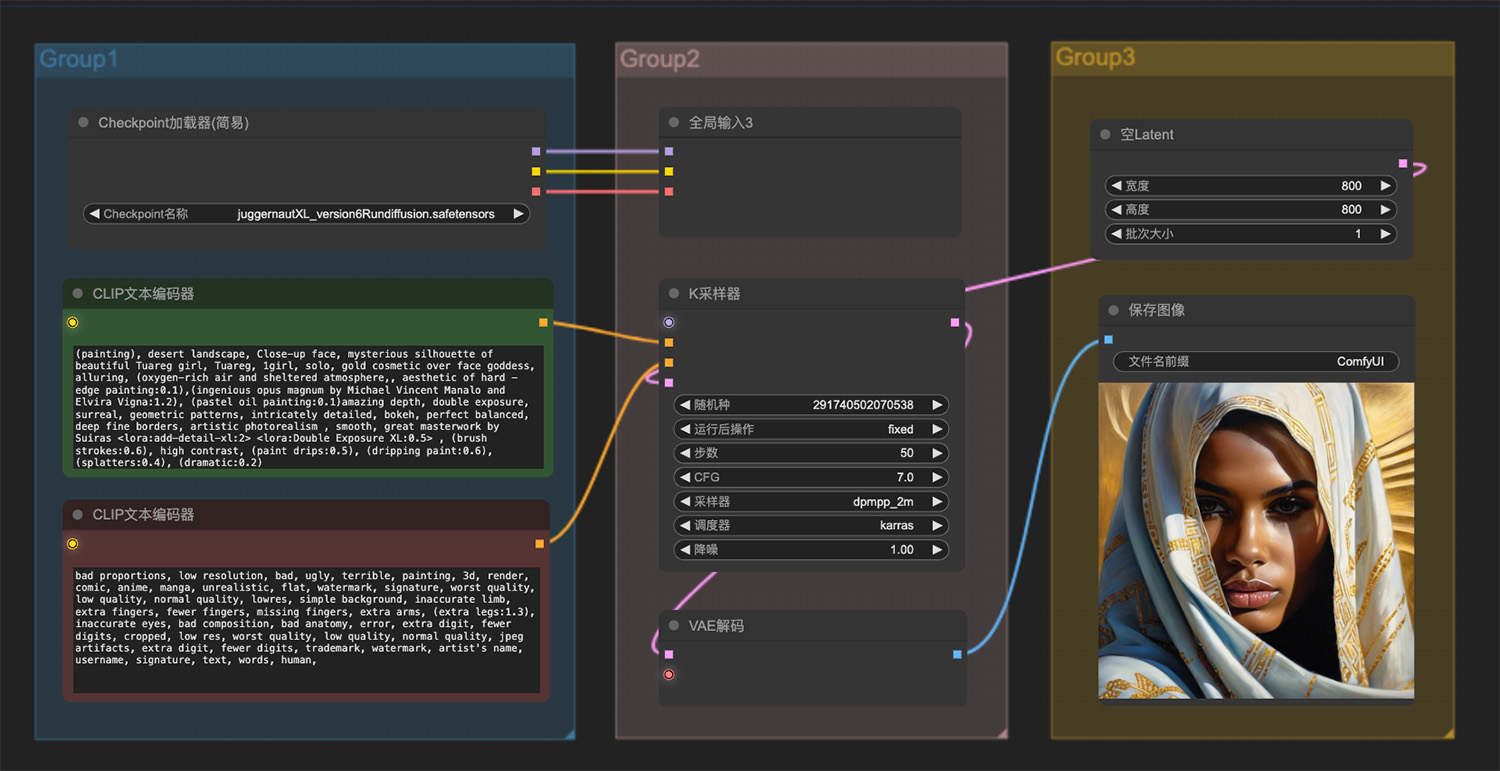

晚上樱花狐狸ComfyUI工作流 沙漠里美丽的图阿雷格女孩ComfyUI工作流

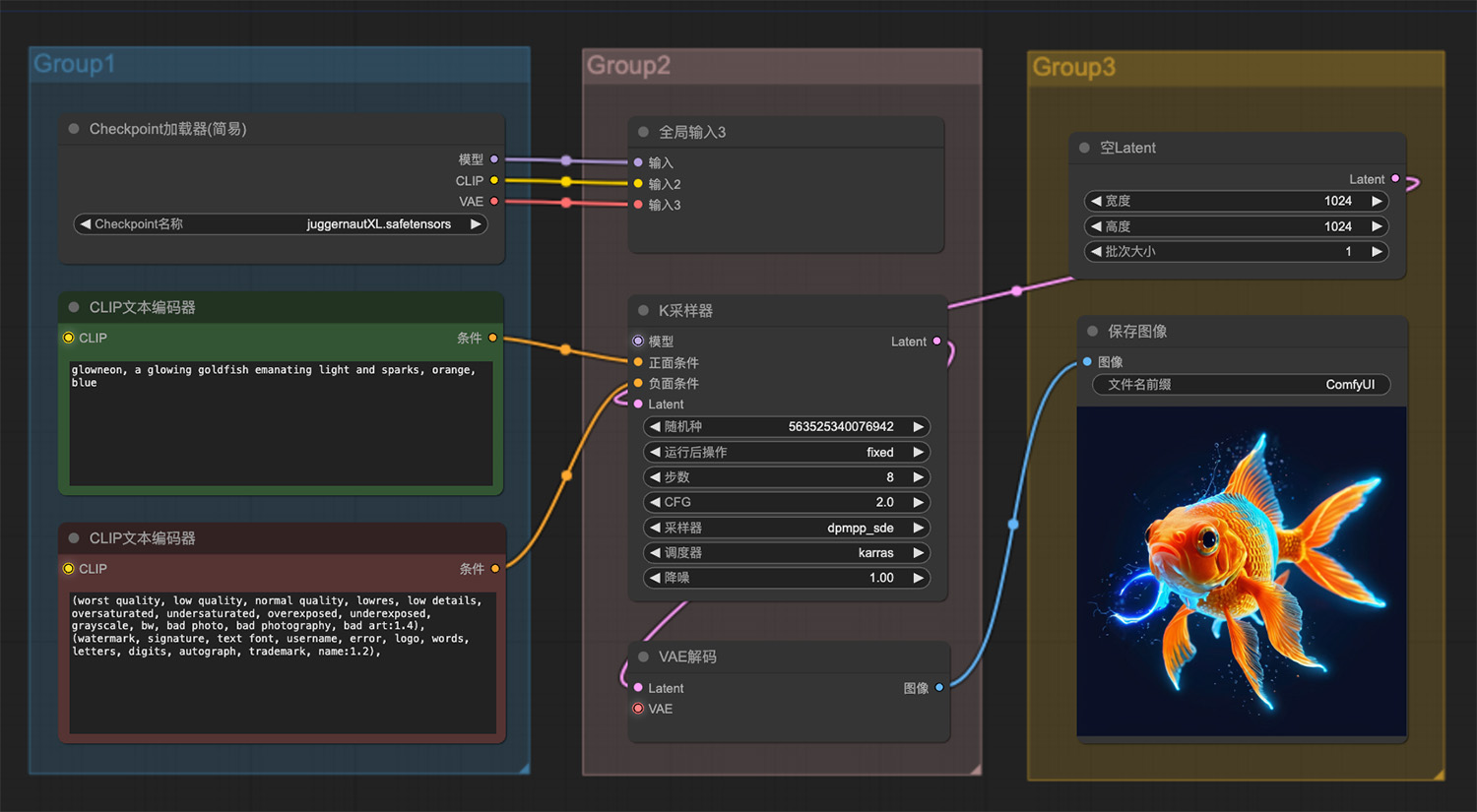

沙漠里美丽的图阿雷格女孩ComfyUI工作流 一条闪闪发光的金鱼ComfyUI工作流

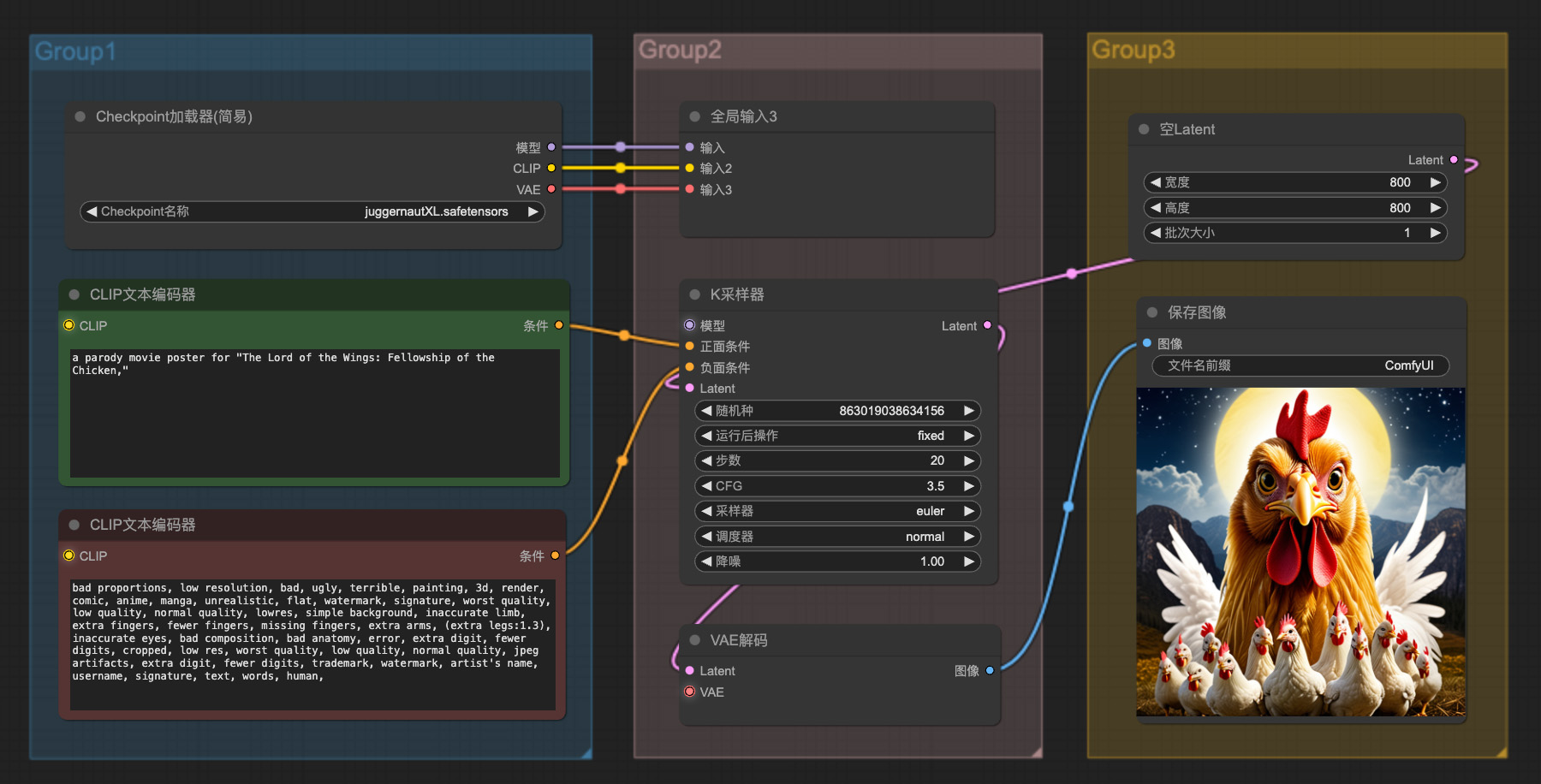

一条闪闪发光的金鱼ComfyUI工作流 《翅膀之王:鸡的团契》海报ComfyUI工作流

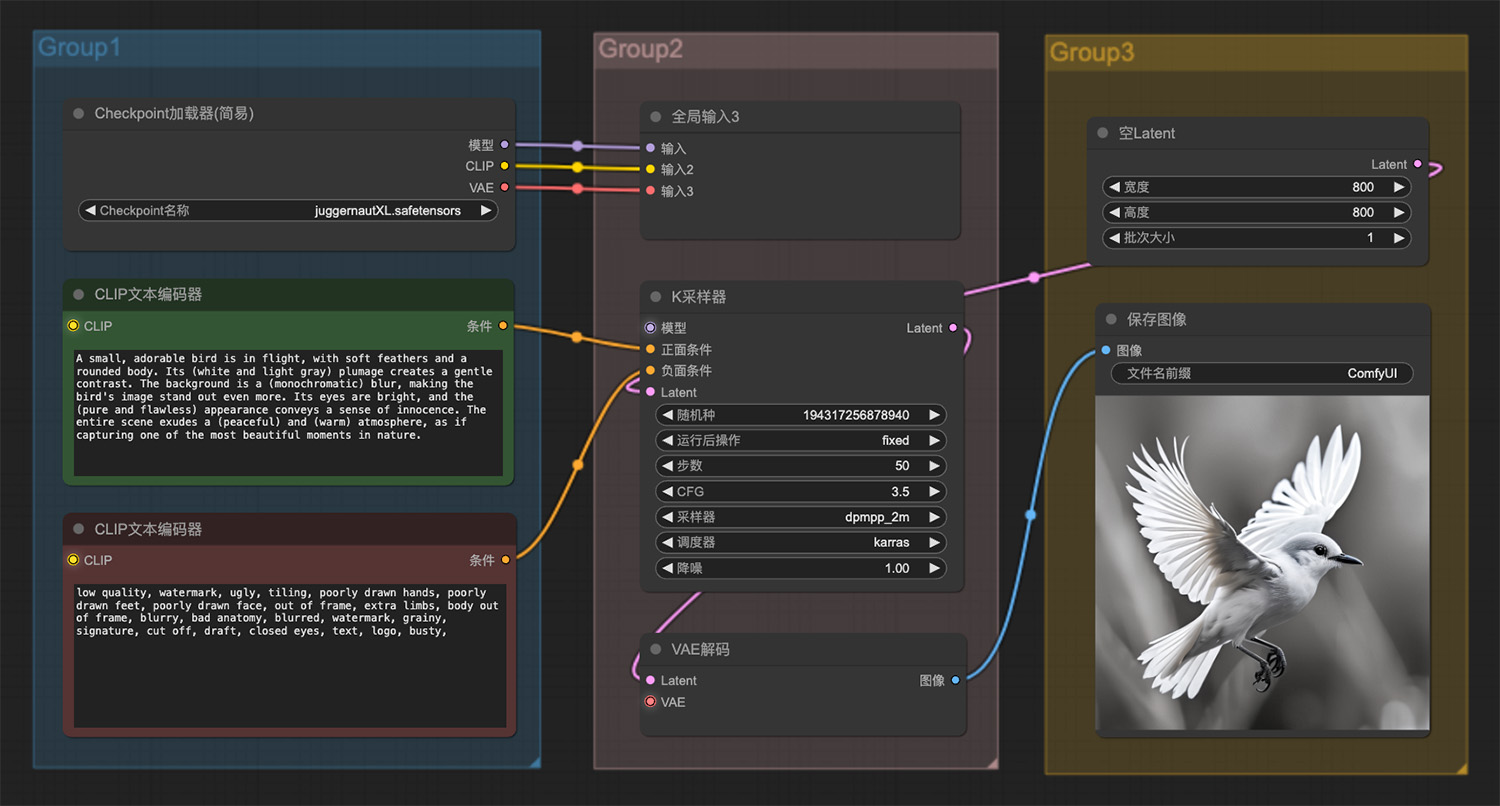

《翅膀之王:鸡的团契》海报ComfyUI工作流 一只可爱的小鸟在飞翔ComfyUI工作流

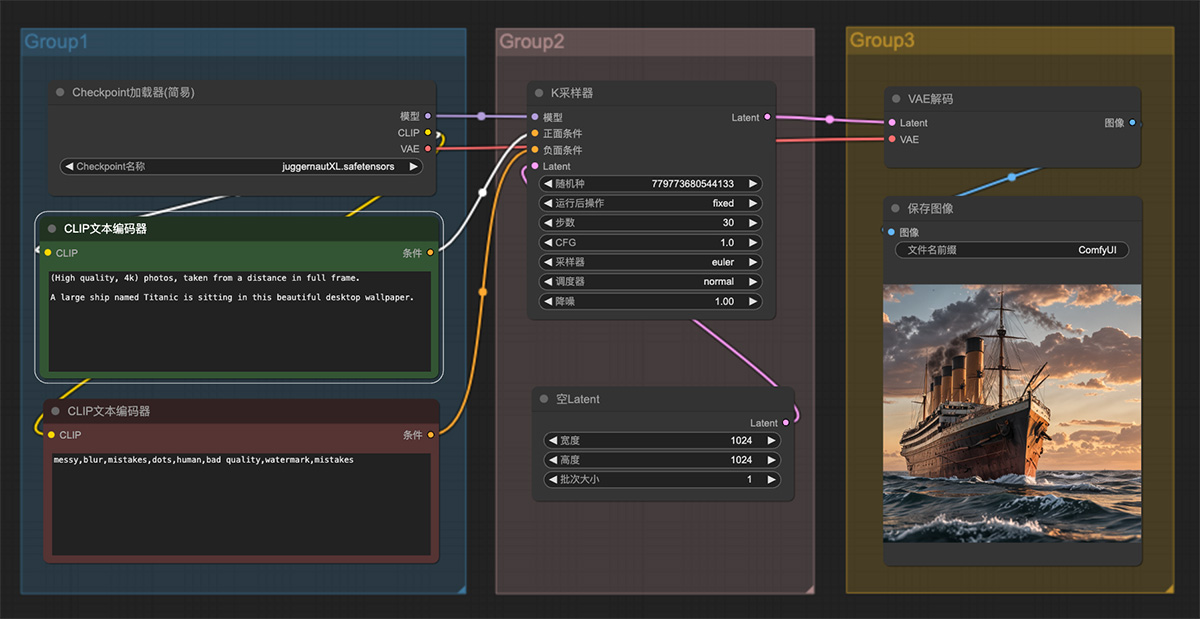

一只可爱的小鸟在飞翔ComfyUI工作流 泰坦尼克号桌面壁纸上ComfyUI工作流

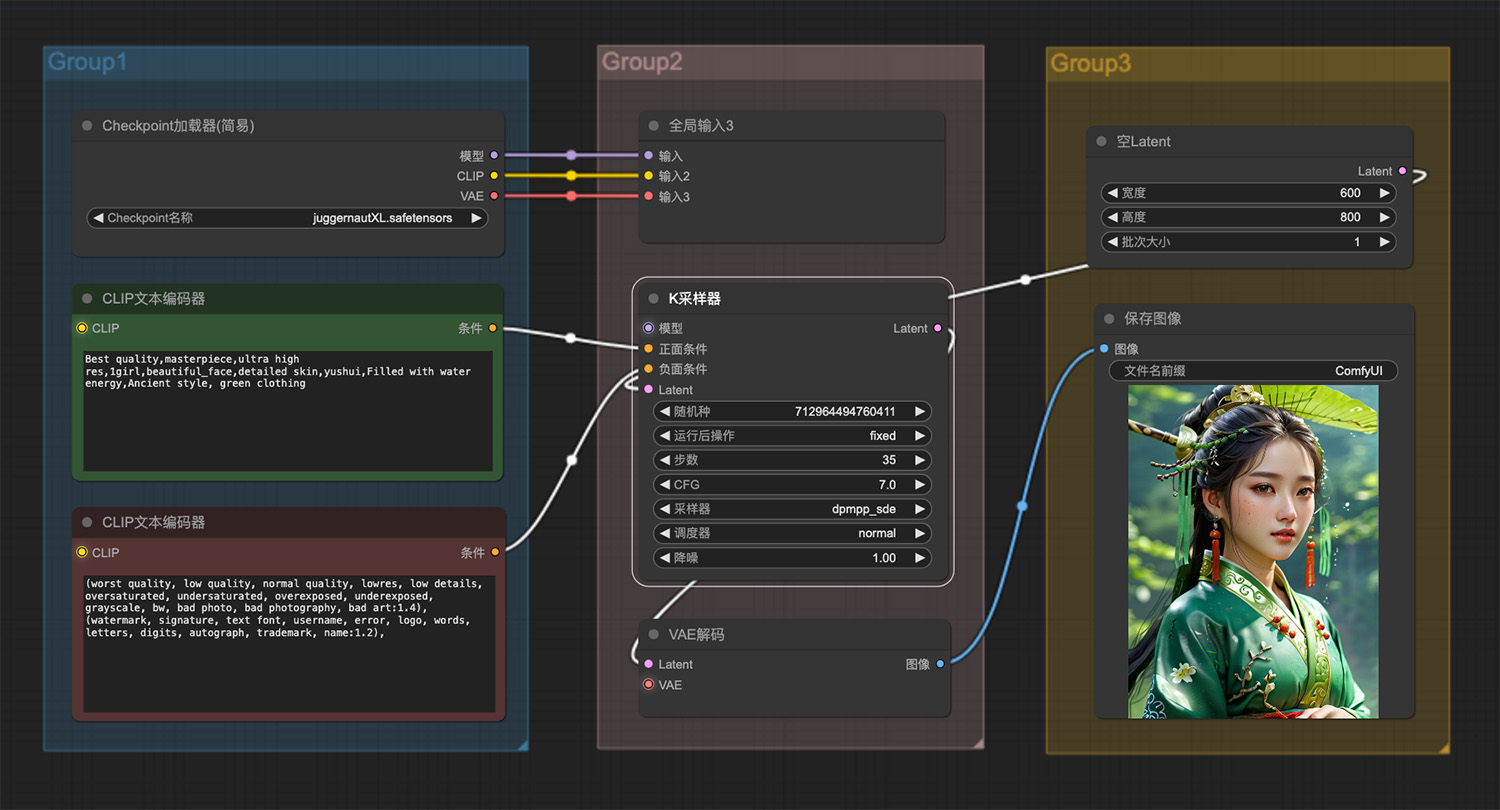

泰坦尼克号桌面壁纸上ComfyUI工作流 一个穿绿衣服国风古典女孩

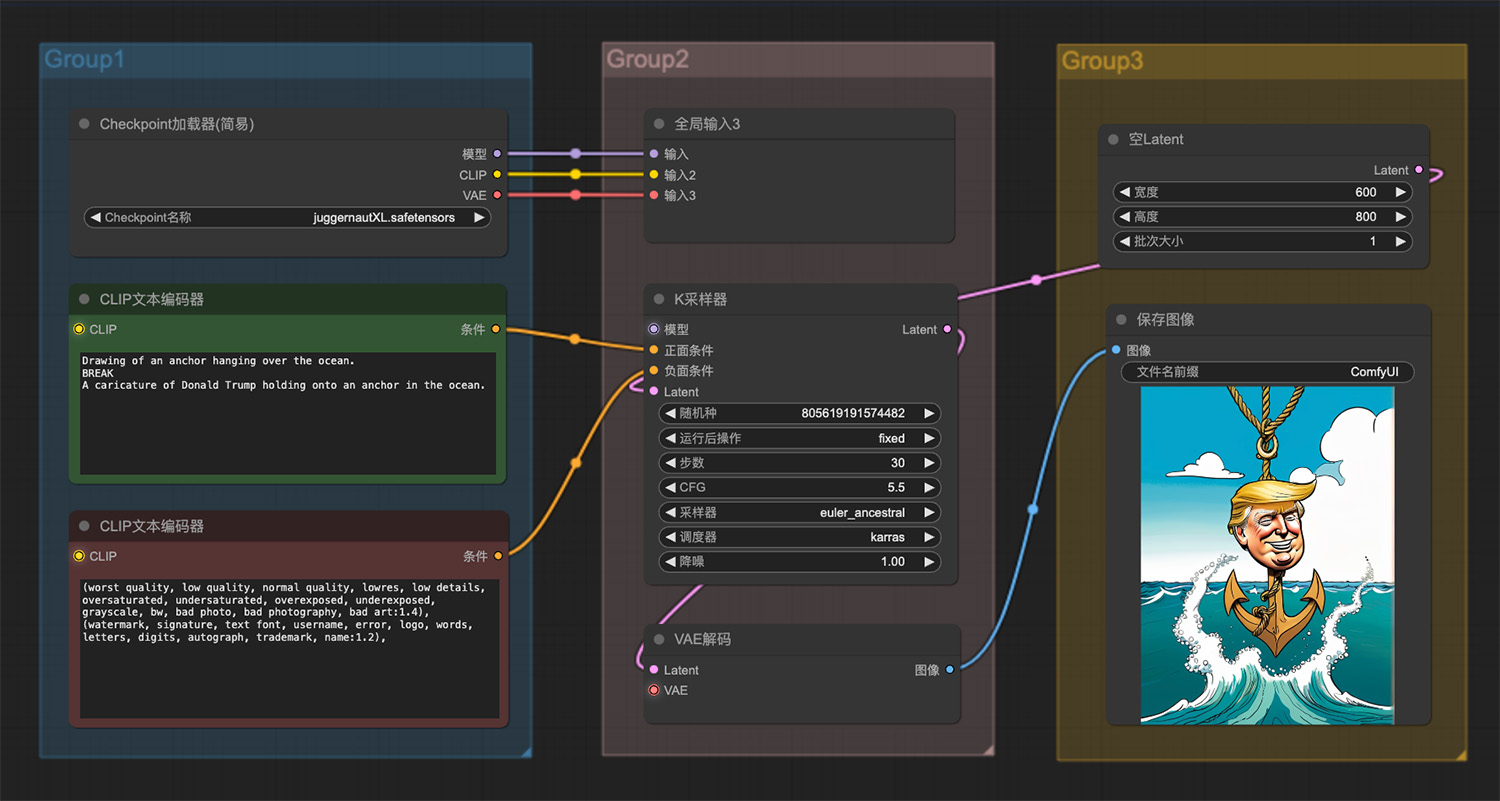

一个穿绿衣服国风古典女孩 懂王特朗普3d漫画ComfyUI工作流

懂王特朗普3d漫画ComfyUI工作流 藏族日历小程序

藏族日历小程序 卡奥斯智能交互引擎

卡奥斯智能交互引擎 高考志愿大模型

高考志愿大模型 啾啾Ai

啾啾Ai 小微助手

小微助手 浙大先生

浙大先生 抖音即创

抖音即创 metaphor

metaphor

彝族日历小程序

彝族日历小程序 Emusion

Emusion NLTK

NLTK 超迹AI

超迹AI AllScale

AllScale DeepWisdom(深度赋智)

DeepWisdom(深度赋智)