AngelSlim压缩工具包模型,腾讯混元AI自研开源全模态大模型

AngelSlim是腾讯混元团队自研并开源的全模态大模型压缩工具套件,通过量化、投机采样、稀疏化、知识蒸馏等技术,为大语言模型(LLM)、视觉语言模型(VLM)及语音模型提供高效、易用、一键式的压缩与推理加速方案。

工具深度集成FP8/INT8/INT4、GPTQ、AWQ等主流压缩策略,支持端到端压缩与无缝部署,产出模型可直接对接vLLM、Sglang等高性能推理框架。本次重磅升级推出首创Eagle3架构,将投机采样首次拓展至全模态场景,实测推理速度最高提升1.4–1.9倍。目前已兼容混元、DeepSeek、Qwen等主流模型生态,开发者可通过pip install angelslim一键安装。

AngelSlim核心功能:

1、多精度量化压缩:

支持FP8、INT8、INT4量化,集成GPTQ、AWQ等先进算法,显著降低模型显存与存储开销。

2、投机采样推理加速:

首创Eagle3训练架构,由小模型生成多步候选token,大模型并行验证,速度最高提升1.4–1.9倍。

3、全模态统一支持:

覆盖LLM、VLM、语音模型(ASR/TTS),业内首次实现投机采样全模态落地。

4、稀疏化与知识蒸馏:

提供结构化/非结构化稀疏剪枝与知识蒸馏,进一步压缩体积并保持能力。

5、一键式调用与低门槛使用:

提供极简API,屏蔽底层复杂度,大幅降低开发者使用成本。

6、无缝对接推理框架:

压缩后模型可直接接入vLLM、Sglang等生态,实现“压缩→训练→部署”全链路打通。

7、主流模型生态兼容:

全面支持Hunyuan、DeepSeek、Qwen、Qwen2.5VL、Qwen3-Omni等开源模型。

AngelSlim技术原理:

1、量化压缩:

将高精度权重(FP16/FP32)映射到低精度格式(INT4/INT8/FP8),结合GPTQ/AWQ最小化精度损失。

2、投机采样(Speculative Decoding):

小模型批量起草候选token,大模型一次性并行验证接受/修正,突破串行解码性能瓶颈。

3、Eagle3前瞻架构:

增强草稿模型多步预测能力,提升单次验证接受长度至1.8–3.5倍,进一步提升加速比。

4、知识蒸馏:

将教师模型的输出分布与隐层特征迁移至学生模型,实现小模型继承大模型效果。

5、结构化/非结构化稀疏:

剪除冗余权重与神经元,降低计算量,适配硬件加速。

6、全模态统一压缩框架:

跨文本、图像、语音设计统一压缩接口与适配层,实现技术能力复用。

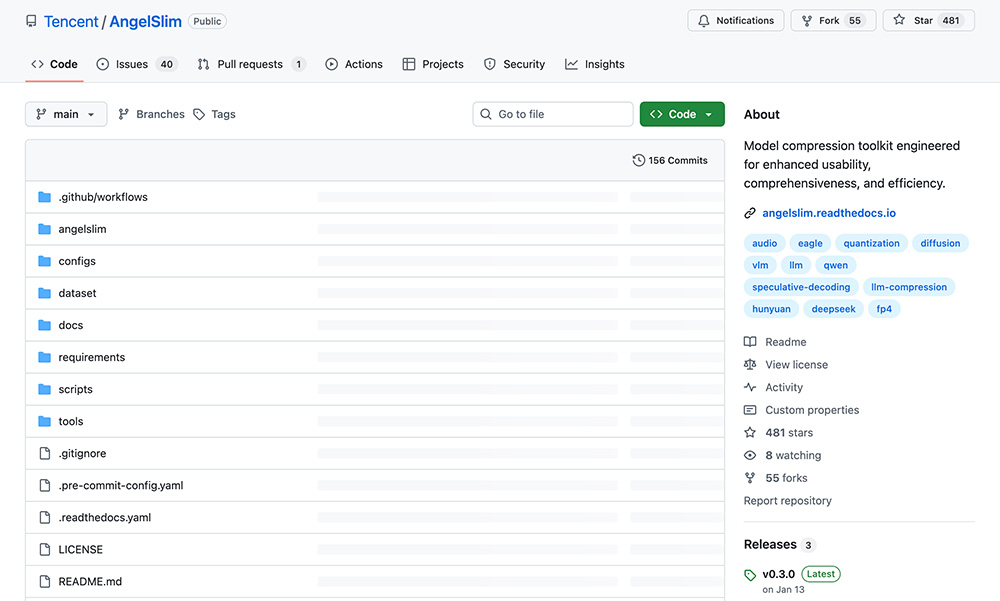

AngelSlim项目地址:

1、GitHub项目地址:https://github.com/Tencent/AngelSlim

2、Hugging Face模型库:https://huggingface.co/collections/AngelSlim

AngelSlim应用场景:

1、云端大模型推理加速:降低千亿级模型显存占用,提升高并发服务吞吐量。

2、端侧轻量化部署:INT4/INT8量化使模型可在手机、IoT等设备离线运行,保护隐私。

3、多模态AI应用加速:加速图文理解、语音转录/合成,赋能智能客服、审核、实时翻译。

4、AIGC生成提效:显著降低首包延迟与生成时间,提升写作、代码、图文描述体验。

5、企业私有化降本:压缩模型后本地部署,大幅减少算力成本,构建高性价比AI中台。

标签:

基金从业资格考试题库

一站式备考基金从业资格考试,收录2021-2025年模拟题库!

热门工具

热门标签

影视名站教师必备SQL语句AI搜索引擎AI办公效率AI学习框架AI写作工具大语言模型AIGC在线教育平台航空航天影视搜索二次元漫画AI内容检测媒体运营

TinyClaw模型使用入口,TinyAGI开源轻量级多智能体协作框架

TinyClaw模型使用入口,TinyAGI开源轻量级多智能体协作框架 AngelSlim压缩工具包模型,腾讯混元AI自研开源全模态大模型

AngelSlim压缩工具包模型,腾讯混元AI自研开源全模态大模型 Arrow 1.0模型,全球首款SVG原生AI矢量图生成模型

Arrow 1.0模型,全球首款SVG原生AI矢量图生成模型 亚马逊全球网点布局大盘点(包括所有开店流程)

亚马逊全球网点布局大盘点(包括所有开店流程) eMAG全球3大国际站大盘点

eMAG全球3大国际站大盘点 美客多全球6大国际站大盘点

美客多全球6大国际站大盘点 Wepost:一个创新的社交媒体营销自动化平台

Wepost:一个创新的社交媒体营销自动化平台 一款支持从 1000 万到 4050 亿参数的模型训练——Oumi

一款支持从 1000 万到 4050 亿参数的模型训练——Oumi 盘点关于DeepSeek的50个高级指令

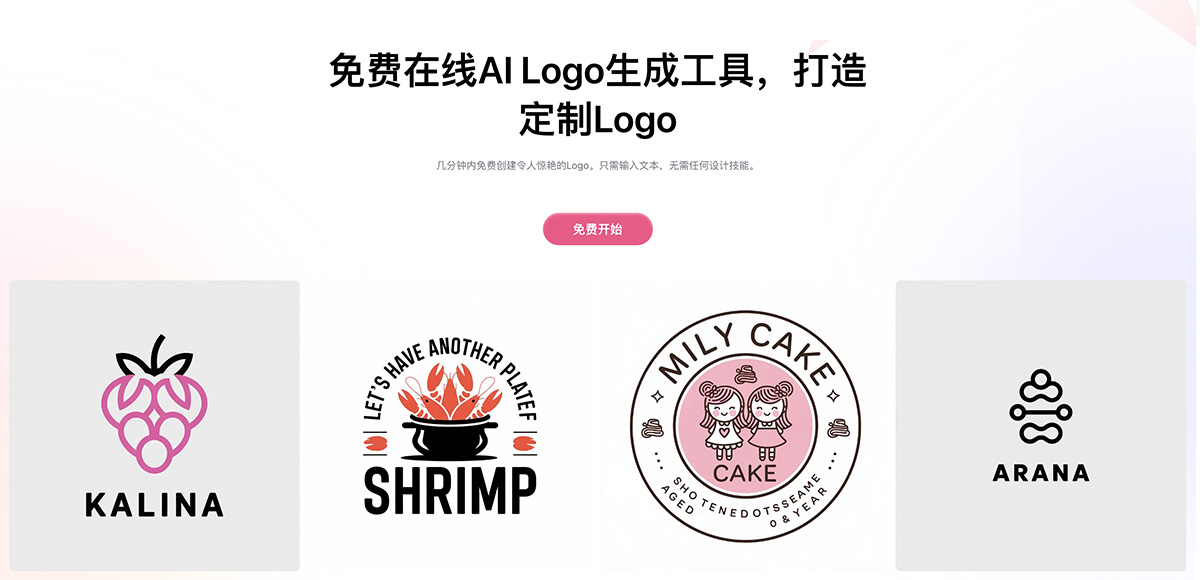

盘点关于DeepSeek的50个高级指令 6款免费AI Logo生成器,快速打造专业品牌标志!

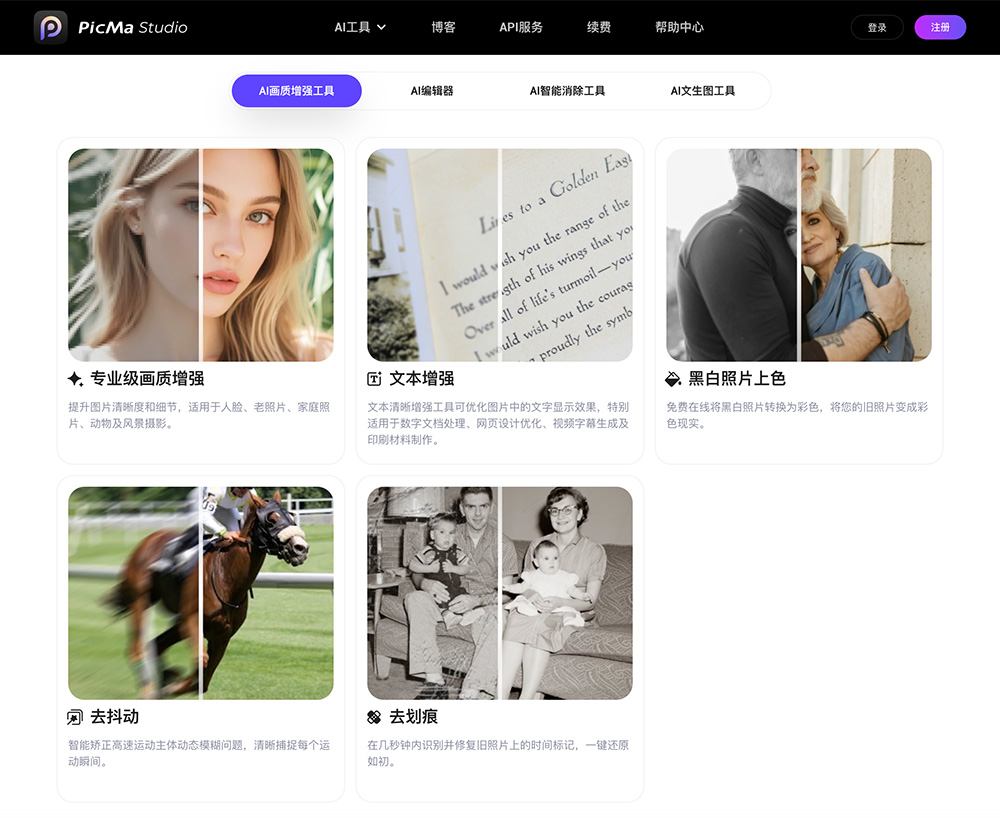

6款免费AI Logo生成器,快速打造专业品牌标志! 热门的ai老照片修复软件有哪些 2025高人气Ai绘图软件排行

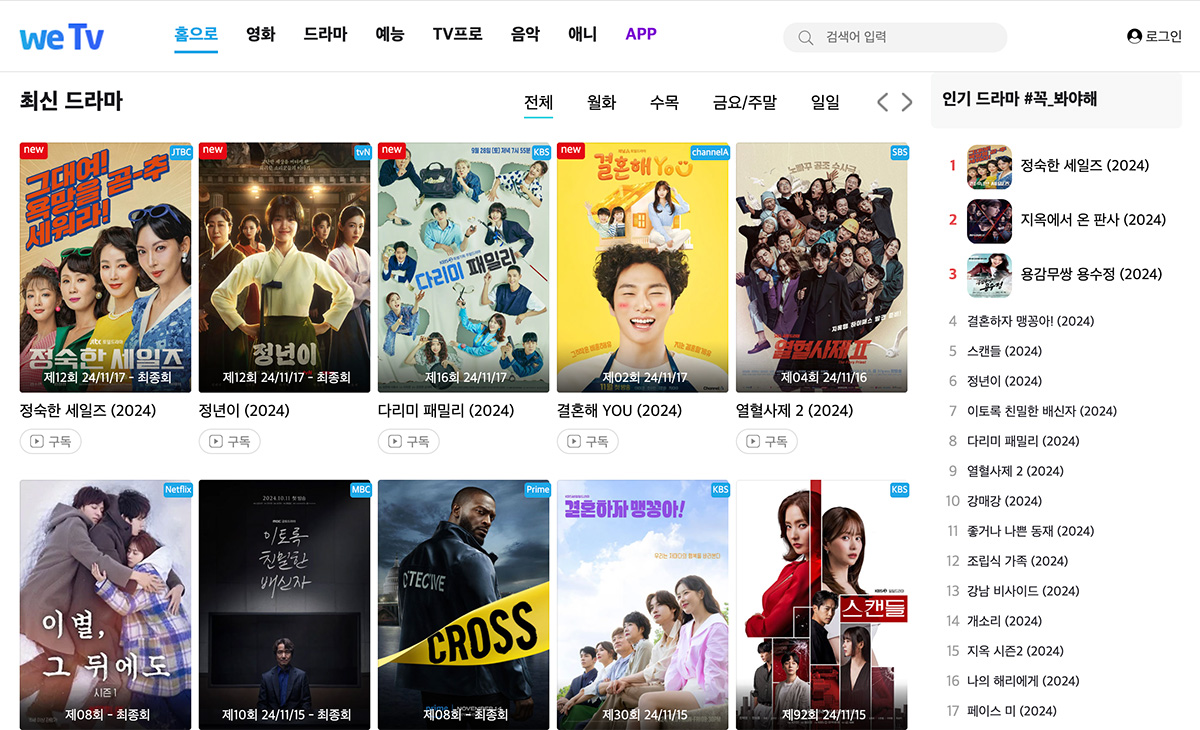

热门的ai老照片修复软件有哪些 2025高人气Ai绘图软件排行 最近韩国电影片在线观看

最近韩国电影片在线观看 Genius Ai

Genius Ai MinerU

MinerU 全国身份证号码在线查询

全国身份证号码在线查询 米尔军事网

米尔军事网