pplx-embed模型,Perplexity扩散预训练多语言文本嵌入模型家族

pplx-embed是Perplexity AI推出的新一代多语言文本嵌入模型家族,涵盖两大核心系列:面向标准检索的pplx-embed-v1与聚焦上下文感知检索的pplx-embed-context-v1,均提供0.6B和4B两种参数规模。模型创新采用扩散式持续预训练技术,将因果解码器转化为双向编码器,实现全向注意力语义理解,原生支持INT8和Binary量化输出,存储压缩比最高可达32倍。无需指令前缀即可在MTEB、ConTEB等权威基准测试中达成SOTA性能,其中pplx-embed-context-v1-4B以81.96%的nDCG@10得分刷新ConTEB基准纪录,兼顾检索精度与部署效率。

pplx-embed核心功能:

1、高效密集文本检索:

将查询与文档映射至统一语义空间,通过近似最近邻搜索实现快速精准召回,适配web级大规模检索场景。

2、上下文感知段落嵌入:

为文档分块生成融合全文上下文的嵌入表示,解决孤立段落语义理解不充分的问题,大幅提升长文档检索精度。

3、多语言跨场景支持:

覆盖30种语言及多种文字脚本,支持跨语言检索、多语言内容匹配等全球化应用需求。

4、极致存储压缩效率:

原生输出INT8(4倍压缩)和Binary(32倍压缩)精度嵌入,无需事后处理即可实现存储成本大幅降低,且性能损失极小。

5、实时低延迟推理:

0.6B轻量版本针对高吞吐量场景优化,在边缘设备、高并发服务中实现速度与精度的平衡,满足实时检索需求。

pplx-embed技术原理:

1、扩散式持续预训练:

基于Qwen3基础模型,禁用因果注意力掩码,通过扩散去噪目标训练模型重建随机掩码token,迫使模型利用双向上下文进行全局理解,成功将自回归解码器转化为双向编码器,提升长文本语义捕捉能力。

2、量化感知训练:

在对比学习全流程采用INT8精度,通过tanh均值池化配合直通梯度估计实现可微分量化,使模型原生学习低精度友好表示,避免传统事后压缩导致的性能损耗。

3、多阶段对比学习课程:

采用阶梯式训练范式:先通过配对训练建立查询与文档的基础语义对齐;再经上下文训练融合文档级全局信息;最后通过难负例三元组训练优化语义决策边界,最终通过球面线性插值合并多阶段检查点,形成性能稳定的最终模型。

pplx-embed项目地址:

1、pplx-embed项目官网:

https://research.perplexity.ai/articles/pplx-embed-state-of-the-art-embedding-models-for-web-scale-retrieval

2、HuggingFace模型库:

https://huggingface.co/collections/perplexity-ai/pplx-embed

3、arXiv技术论文:

https://arxiv.org/pdf/2602.11151

pplx-embed应用场景:

1、搜索引擎与问答系统:

作为百亿级网页库的第一阶段检索器,快速召回候选文档供下游重排序和生成模型使用,支撑实时搜索问答服务,在PPLXQuery2Doc内部基准中展现卓越的web级检索性能。

2、RAG知识库构建:

为企业内部文档、知识库生成高压缩比嵌入,以极低存储成本实现高效语义检索,pplx-embed-v1-4B在BERGEN端到端RAG基准中超越同类大参数模型,适配企业级知识库问答场景。

3、多语言内容平台:

适用于全球化内容推荐、多语言客服系统、跨国企业文档管理等场景,在MIRACL多语言检索基准中表现优于同类模型。

4、边缘设备与实时应用:

轻量版模型适配移动端搜索、物联网设备本地检索、高并发实时推荐等对速度敏感的场景,平衡推理效率与检索精度。

5、长文档智能处理:

上下文感知版本通过late chunking技术,为法律合同、学术论文、技术文档等长文本分块生成语义连贯的段落嵌入,在ConTEB长文档检索基准中刷新纪录,提升专业文档处理效率。

标签:

基金从业资格考试题库

一站式备考基金从业资格考试,收录2021-2025年模拟题库!

热门工具

热门标签

AI图像处理查询检测在线短剧AI开发框架AI写真3D模型游戏平台AI学习框架电影下载AI抠图AI金融事务生物医学创意设计AI写作工具AI效率提升

Arrow 1.0模型,全球首款SVG原生AI矢量图生成模型

Arrow 1.0模型,全球首款SVG原生AI矢量图生成模型 pplx-embed模型,Perplexity扩散预训练多语言文本嵌入模型家族

pplx-embed模型,Perplexity扩散预训练多语言文本嵌入模型家族 SkyReels V4模型使用入口,昆仑万维全球首创多模态音视频生成大模型

SkyReels V4模型使用入口,昆仑万维全球首创多模态音视频生成大模型 亚马逊全球网点布局大盘点(包括所有开店流程)

亚马逊全球网点布局大盘点(包括所有开店流程) eMAG全球3大国际站大盘点

eMAG全球3大国际站大盘点 美客多全球6大国际站大盘点

美客多全球6大国际站大盘点 2025年1月中文版AI工具流量排行榜top50

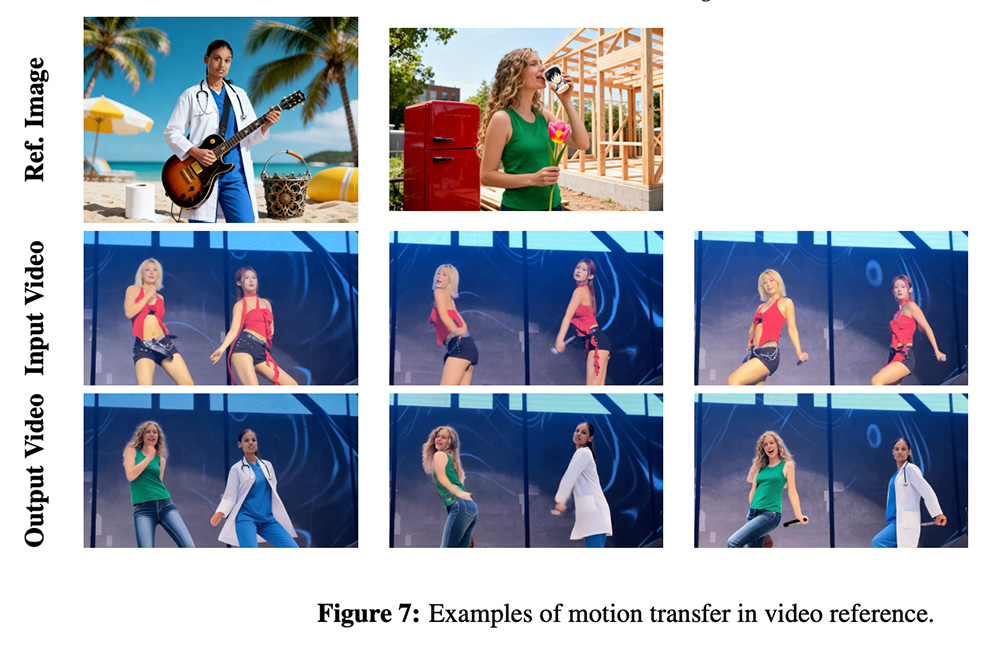

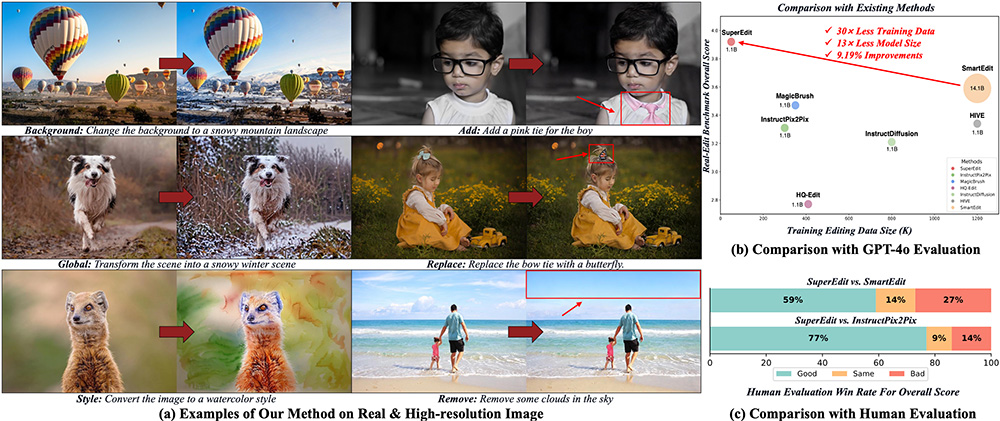

2025年1月中文版AI工具流量排行榜top50 SuperEdit:字节团队和佛罗里达中央大学计算机视觉研究中心联合开发的一种新型图像编辑方法

SuperEdit:字节团队和佛罗里达中央大学计算机视觉研究中心联合开发的一种新型图像编辑方法 夸克AI眼镜

夸克AI眼镜 8款免费AI虚拟试衣工具,一键在线试穿,轻松搞定服装搭配!

8款免费AI虚拟试衣工具,一键在线试穿,轻松搞定服装搭配! 5款免费AI商拍工具,一键生成爆款商品图

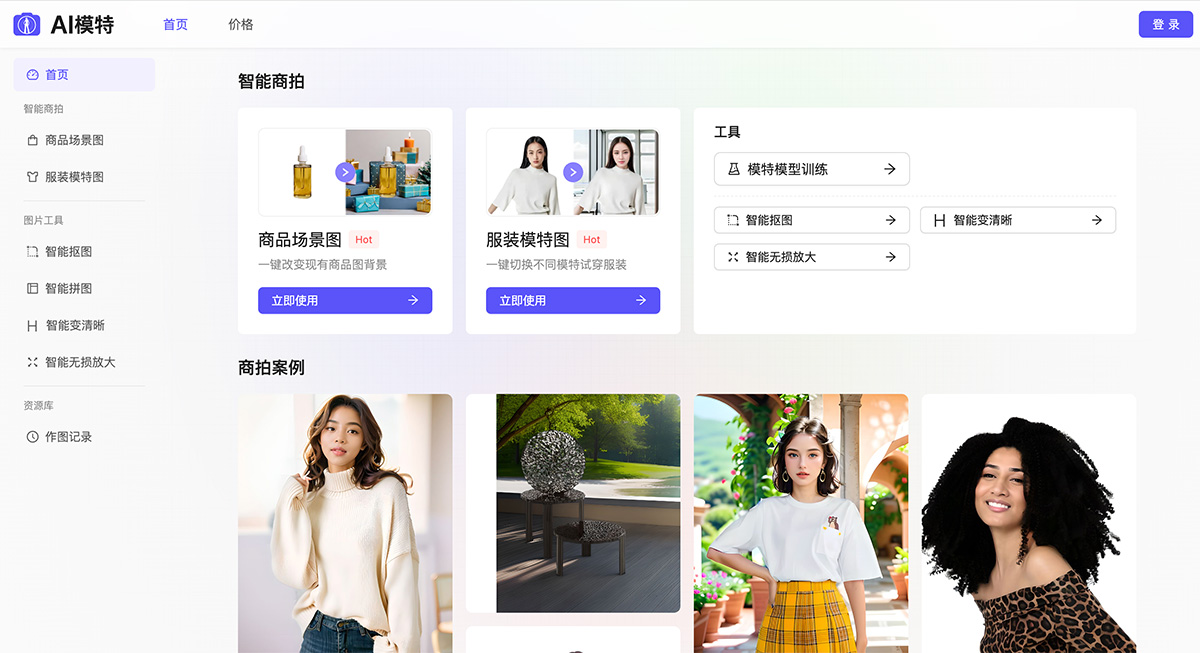

5款免费AI商拍工具,一键生成爆款商品图 悬河AI

悬河AI 在线设计协作工具合集

在线设计协作工具合集 天书AI

天书AI Hyprnote

Hyprnote 潮际好麦

潮际好麦