SyncAnimation:南方科技大学等机构推出的端到端音频驱动框架

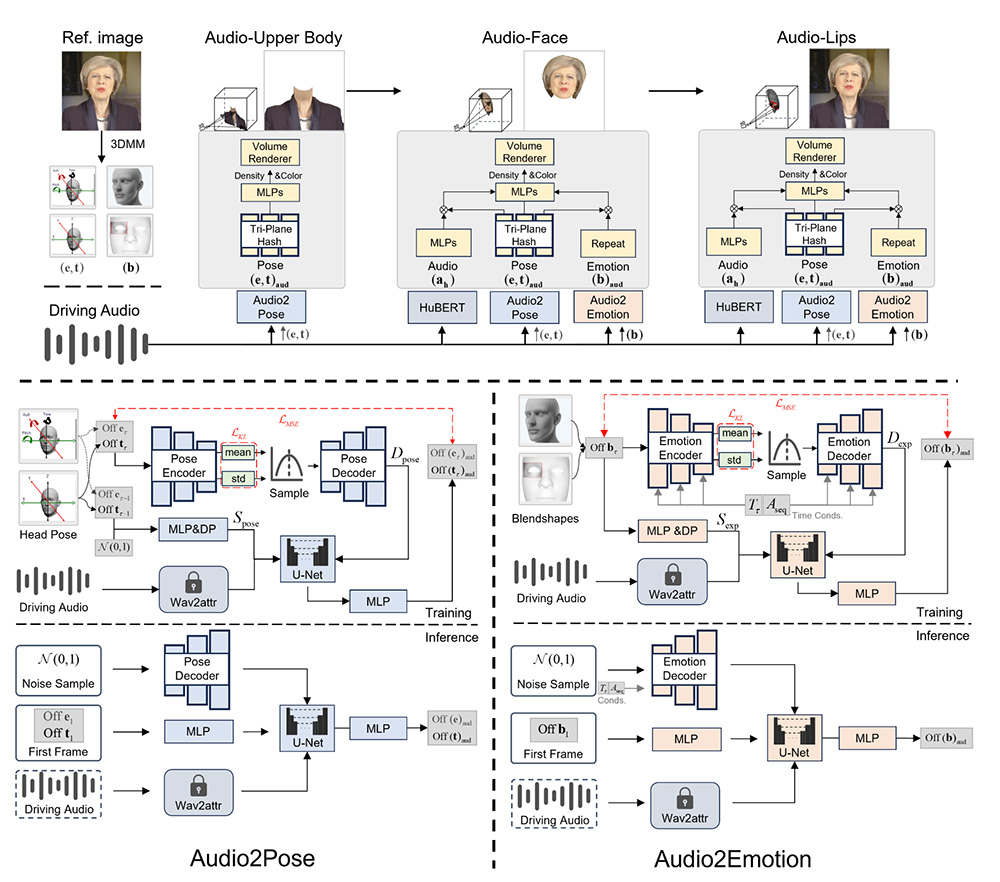

SyncAnimation是由南方科技大学等机构推出的一种实时端到端的音频驱动框架,用于生成与音频同步的人体姿态和说话头像动画。该框架基于NeRF(神经辐射场)技术,结合音频到姿态和表情的同步模块,能够通过音频信号实时生成高精度、高同步性的上半身姿态和面部表情,包括嘴唇动作。

SyncAnimation功能特点:

1、音频驱动的实时渲染:通过音频信号实时生成说话头像和上半身姿态,支持“一镜到底”(单次推理,使用一张参考图像)和“零镜到底”(零次推理,完全不依赖参考图像)两种推理方式。

2、高精度姿态与表情生成:

AudioPose Syncer:将音频信号映射到动态头部姿态,生成与音频同步的头部姿态偏移量。

AudioEmotion Syncer:通过音频特征驱动面部表情变化,包括眉毛动作、眨眼等细节,实现自然的情感表达。

3、无缝融合与同步渲染:High-Synchronization Human Renderer模块确保头部和上半身动作的无缝融合,实现音频同步的嘴唇动作,无需后期处理。

4、保持身份信息与细节:在静音期间,能够保持面部表情和上半身动作的一致性,同时保留人物的身份信息和面部细节。

5、高实时性能:在NVIDIA RTX 4090 GPU上,推理速度可达41 FPS,是首个能实时生成音频同步上半身运动和头部动作的方法。

SyncAnimation应用场景:

1、虚拟主播与直播:适用于新闻播报、直播教学等场景,能够实时生成与音频高度同步的虚拟人物动画。

2、视频会议与远程协作:在网络带宽受限的情况下,通过音频驱动生成逼真的虚拟人物头像,保持高质量的视觉效果。

3、动画制作与影视特效:可用于动画制作和影视特效中的人物动画生成,提高制作效率,实现更加自然的动态效果。

4、游戏开发:生成实时的NPC动画,使角色的动作和表情更加生动,提升游戏的沉浸感。

5、智能客服与虚拟助手:生成虚拟客服或助手的动画形象,在与用户互动时表现出更加自然的表情和姿态。

SyncAnimation项目网址:

1、项目官网:https://syncanimation.github.io/

2、GitHub仓库:https://github.com/syncanimation

3、arXiv技术论文:https://arxiv.org/pdf/2501.14646

标签:

基金从业资格考试题库

一站式备考基金从业资格考试,收录2021-2025年模拟题库!

热门工具

热门标签

电影资源音频工具OCR识别ppt模板AI内容检测文字工具AI营销工具电子书AI办公工具AI企业服务AI数字虚拟人航空航天SQL语句AI思维导图二手交易

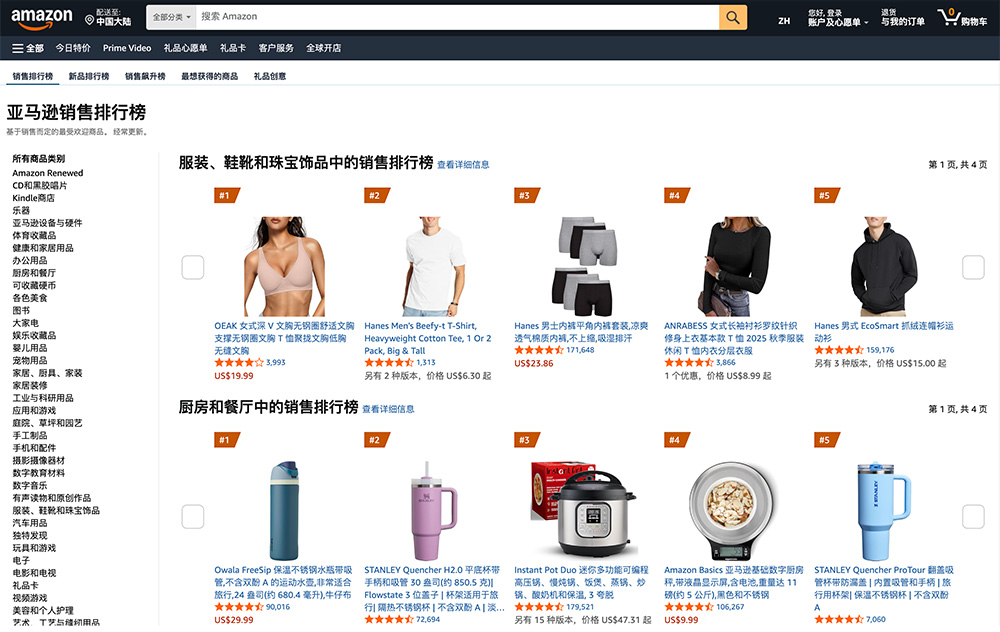

盘点亚马逊各国销售榜网址汇总

盘点亚马逊各国销售榜网址汇总 Fruugo北美跨境电商平台(盘点Fruugo北美跨境电商登录网址)

Fruugo北美跨境电商平台(盘点Fruugo北美跨境电商登录网址) Qwen3大模型系列合集,覆盖多个领域!

Qwen3大模型系列合集,覆盖多个领域! 亚马逊全球网点布局大盘点(包括所有开店流程)

亚马逊全球网点布局大盘点(包括所有开店流程) eMAG全球3大国际站大盘点

eMAG全球3大国际站大盘点 美客多全球6大国际站大盘点

美客多全球6大国际站大盘点 一个由谷歌提出的一种多智能体协作框架—— CoA

一个由谷歌提出的一种多智能体协作框架—— CoA Comfy UI入门教程:AI绘画工作流ComfyUI搭建步骤

Comfy UI入门教程:AI绘画工作流ComfyUI搭建步骤 Seed-TTS:字节跳动开发的高质量、多功能的文本到语音(TTS)模型

Seed-TTS:字节跳动开发的高质量、多功能的文本到语音(TTS)模型 互联网最火的10个大语言模型及其应用场景全解析

互联网最火的10个大语言模型及其应用场景全解析 免费AI数据分析神器:一键生成可视化图表,轻松搞定复杂数据

免费AI数据分析神器:一键生成可视化图表,轻松搞定复杂数据 Job In Corner

Job In Corner 爱改写

爱改写 AIBox365

AIBox365 roop

roop EndlessVN

EndlessVN