复旦大学推出的语音交互模型SpeechGPT 2.0-preview

SpeechGPT 2.0-preview 是复旦大学 OpenMOSS 团队推出的首个拟人化实时交互系统。该系统基于百万小时级中文语音数据训练,采用端到端架构,实现了语音与文本模态的高度融合。它具有拟人口语化表达、百毫秒级低延迟响应,支持自然流畅的实时打断交互。目前,SpeechGPT 2.0-preview 仅在中文语音数据上进行了训练,暂不支持英文对话。

SpeechGPT 2.0-preview功能特点:

1、情感与风格控制:支持多情感(如虚弱、欢快)、多音色(男女切换)及多风格(诗歌朗诵、方言模仿)的精准控制,角色扮演能力突出。

2、实时打断交互:百毫秒级响应速度支持自然对话中的即时打断与续接。

3、文本能力集成:在语音表现力基础上,保留文本模型的智商,支持工具调用、联网搜索、外挂知识库接入等功能。

4、多任务兼容性:可处理长文档解析、多轮对话等场景,兼容短文本任务的性能未因长上下文能力而降低。

5、语音才艺:具备诗歌朗诵、故事讲述、说方言等多种语音才艺。

SpeechGPT 2.0-preview技术原理:

端到端语音建模:

1、超低比特率流式语音 Codec:自研的超低比特率流式语音 Codec,能够处理 24kHz 的语音输入,将语音压缩至每秒 75 个 token,支持流式输入输出,实现 200ms 以内延迟的实时交互。

2、语义-声学联合建模:通过语义-声学联合建模,直接处理语音输入并生成语音或文本输出,无需传统级联式 ASR(语音识别)和 TTS(语音合成)模块。

语音-文本混合建模:

1、Codec Patchify:通过 Codec Patchify 技术聚合相邻时间步的语音 token 为统一向量,有效减小语音和文本序列之间的模态差异,缓解跨模态建模中的冲突问题。

2、多阶段训练流程:包括模态适应预训练、跨模态指令微调和链式模态微调,兼顾文本能力与语音能力,避免模型在学习语音能力时降低智商。

3、语音文本对齐预训练:通过充分的语音文本对齐预训练,模型可以“涌现”出语音风格的泛化性,例如无需语速调整数据即可控制语速,或模仿未见过的角色语气风格。

SpeechGPT 2.0-preview的优点:

1、低延迟交互:百毫秒级的响应速度支持自然流畅的实时打断交互,用户体验极佳。

2、多模态能力:能够精准控制情感、风格和音色,支持多种语音才艺,如诗歌朗诵、故事讲述和方言模仿。

3、强大的文本能力:在具备语音表现力的同时,保留了文本模型的智商,支持工具调用、联网搜索和外挂知识库等功能。

4、开源支持:模型代码、权重及技术报告完全开源(Apache 2.0协议),提供 Hugging Face 预训练模型和 Gradio 演示界面,支持本地部署。

SpeechGPT 2.0-preview的缺点:

1、仅支持中文:目前仅在中文语音数据上训练,暂不支持英文对话。

2、复杂性:模型的技术架构较为复杂,需要一定的技术背景才能进行部署和优化。

3、资源需求:虽然模型本身优化了推理效率,但训练和部署仍需要较高的计算资源。

SpeechGPT 2.0-preview的项目地址:

1、项目官网:https://www.open-moss.com/cn/speechgpt2-preview/

2、GitHub仓库:https://github.com/OpenMOSS/SpeechGPT-2.0-preview

3、HuggingFace模型库:https://huggingface.co/fnlp/SpeechGPT-2.0-preview-7B

4、在线体验Demo:https://sp2.open-moss.com/

SpeechGPT 2.0-preview应用场景:

1、智能助手:支持自然语音交互的客服、教育或医疗助手,如实时口语练习、情感陪伴。

2、内容创作:自动生成有声书、诗歌朗诵或方言内容,丰富多媒体创作形式。

3、无障碍通信:为听障或言语障碍者提供实时语音转文字及合成服务。

标签:

基金从业资格考试题库

一站式备考基金从业资格考试,收录2021-2025年模拟题库!

热门工具

热门标签

影视资源国产AI在线影视AI法律服务自学AIGC实用工具在线短剧谷歌插件知识百科办公生活ai换脸体育频道法律咨询搜索引擎

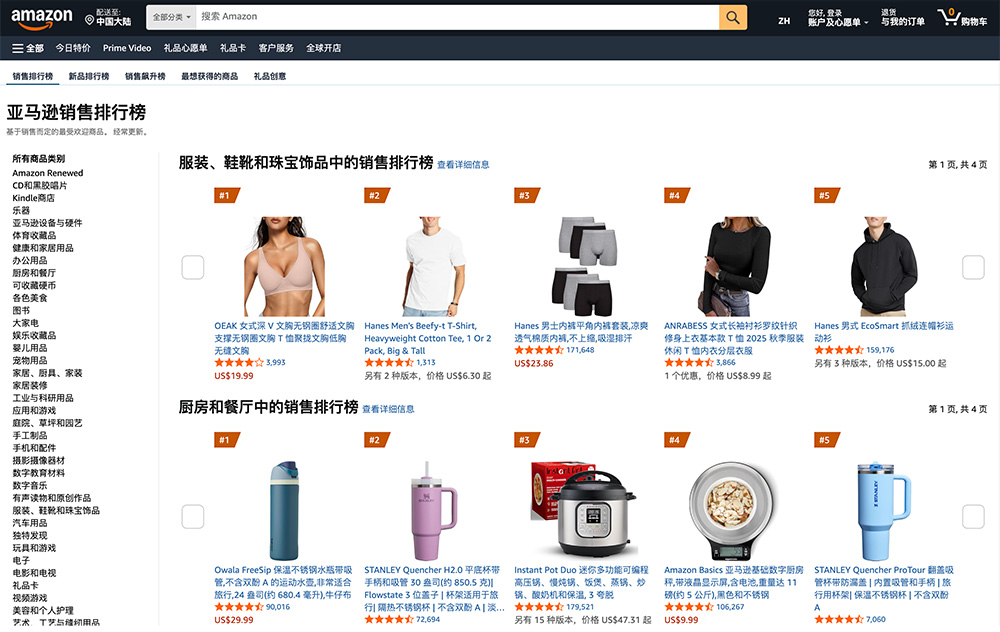

盘点亚马逊各国销售榜网址汇总

盘点亚马逊各国销售榜网址汇总 Fruugo北美跨境电商平台(盘点Fruugo北美跨境电商登录网址)

Fruugo北美跨境电商平台(盘点Fruugo北美跨境电商登录网址) Qwen3大模型系列合集,覆盖多个领域!

Qwen3大模型系列合集,覆盖多个领域! 亚马逊全球网点布局大盘点(包括所有开店流程)

亚马逊全球网点布局大盘点(包括所有开店流程) eMAG全球3大国际站大盘点

eMAG全球3大国际站大盘点 美客多全球6大国际站大盘点

美客多全球6大国际站大盘点 Comfy UI入门教程:AI绘画工作流ComfyUI搭建步骤

Comfy UI入门教程:AI绘画工作流ComfyUI搭建步骤 一个由谷歌提出的一种多智能体协作框架—— CoA

一个由谷歌提出的一种多智能体协作框架—— CoA Seed-TTS:字节跳动开发的高质量、多功能的文本到语音(TTS)模型

Seed-TTS:字节跳动开发的高质量、多功能的文本到语音(TTS)模型 免费AI数据分析神器:一键生成可视化图表,轻松搞定复杂数据

免费AI数据分析神器:一键生成可视化图表,轻松搞定复杂数据 互联网最火的10个大语言模型及其应用场景全解析

互联网最火的10个大语言模型及其应用场景全解析 AIBox365

AIBox365 Job In Corner

Job In Corner EndlessVN

EndlessVN roop

roop 爱改写

爱改写