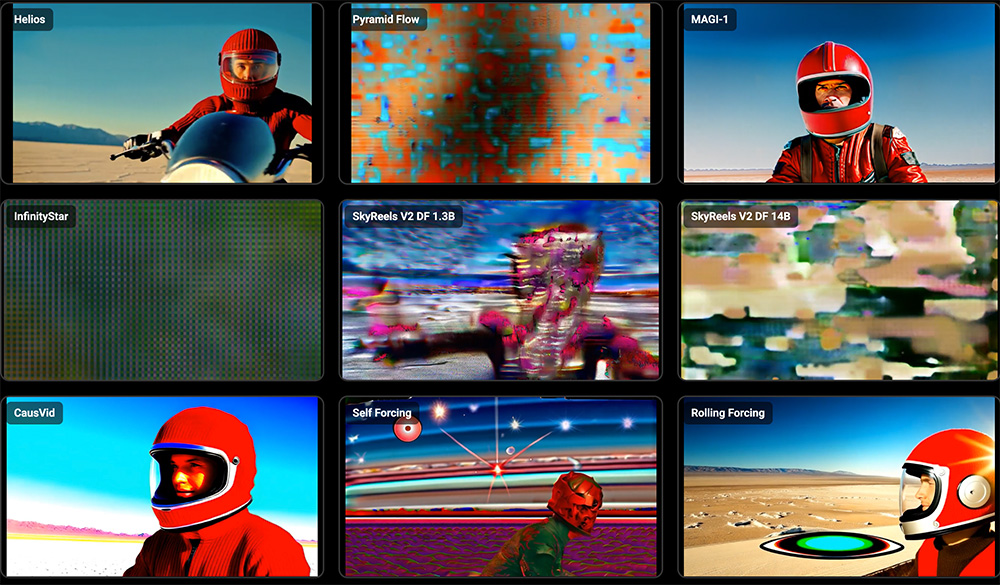

Helios视频生成模型入口,北大与字节等机构联合研发的14B参数实时长视频生成模型

Helios是由北京大学与字节跳动等机构联合研发的14B参数实时长视频生成模型,可在单张H100GPU上以19.5FPS实现分钟级高质量视频生成。模型不依赖KV缓存、量化、因果掩码等传统加速方案,通过统一历史注入、深度压缩流、对抗分层蒸馏等原创技术,将计算成本降至1.3B模型级别,在生成速度、内容质量、长时序连贯性上全面领先现有方案,且模型与代码已完全开源。

Helios核心功能:

1、文生视频:

支持文本描述直接生成高画质、高连贯性视频内容,语义理解精准,画面表现力强。

2、图生视频:

将静态图片转化为自然流畅的动态视频,保留原图风格与主体结构,动态效果自然。

3、视频续写/风格转换:

基于已有视频进行内容续写、时长扩展或风格迁移,保持时序一致与画面稳定。

4、实时交互式生成:

支持生成过程中动态修改提示词,可实时调整内容、风格与镜头,交互体验流畅。

5、分钟级长视频生成:

稳定生成最高1440帧的长视频,画面不漂移、不重复、时序连贯。

Helios技术原理:

1、统一历史注入:

将历史帧与噪声帧拼接作为输入,把双向预训练模型改造为自回归生成器。

- 历史帧时间步固定为0,保证信息干净

- 噪声帧负责去噪生成

- 同一架构自适应三大任务:

历史全零 → 文生视频

仅末帧非零 → 图生视频

任意历史帧非零 → 视频续写

2、引导注意力机制:

- 自注意力层:分别计算历史与噪声上下文的QKV,通过头级放大令牌调节历史信息强度

- 交叉注意力层:仅向噪声上下文注入文本语义,避免历史信息重复叠加

- 实现两类上下文统计特性解耦,提升生成稳定性与语义一致性

3、简易抗漂移策略:

- 相对位置编码:固定时间索引范围,消除长视频位置偏移

- 全局锚点机制:强制保留首帧,抑制颜色与结构漂移

- 训练扰动增强:对历史帧随机加入曝光、噪声、模糊等扰动,模拟推理误差累积,从源头减少重复与抖动

4、深度压缩流:

- 多期记忆分块:按历史帧远近采用差异化压缩率,保持令牌预算恒定

- 金字塔统一预测校正器:在多尺度潜空间分阶段采样

低分辨率先确定全局结构 → 高分辨率再精细优化细节

- 把 14B 模型的令牌计算量压缩至 1.3B 模型水平

5、对抗分层蒸馏:

- 以自回归教师模型为基准,分阶段反向仿真得到多尺度估计

- 动态重噪声调度实现课程式学习

- 对抗后训练突破教师模型性能上限

- 采样步数从 50 步压缩至 3 步,且无需分类器引导

Helios应用场景:

1、影视与广告制作:

实时生成能力大幅加速电影预告片、广告创意、动态分镜流程,创作者可快速迭代视觉方案,将传统数小时渲染缩短至分钟级。

2、游戏与交互娱乐:

作为世界模型核心组件,支持实时生成无限长度游戏场景与动态环境,为开放世界游戏、VR/AR体验、交互式叙事提供稳定、连续的视觉流。

3、社交媒体与内容创作:

普通用户可通过文字或图片一键生成电影级短视频,大幅降低专业视频制作门槛,赋能个人创作者高效产出高质量内容。

4、设计与原型验证:

设计师可将静态设计稿转为动态演示,实时预览产品动画与交互效果,快速验证方案、缩短迭代周期,提升设计交付效率。

Helios的项目地址:

1、项目官网:https://pku-yuangroup.github.io/Helios-Page/

2、GitHub仓库:https://github.com/PKU-YuanGroup/Helios

3、HuggingFace模型库:https://huggingface.co/collections/BestWishYsh/helios

4、arXiv技术论文:https://arxiv.org/pdf/2603.04379

标签:

基金从业资格考试题库

一站式备考基金从业资格考试,收录2021-2025年模拟题库!

热门工具

热门标签

游戏平台资源服务平台AI写作工具实用工具谷歌插件AI效率提升国产AIUI组件库学术论文AI头像绘制思维导图AI办公工具文字工具二手交易办公提效

StepClaw云端AI助手,阶跃AI基于OpenClaw架构推出的云端AI智能体

StepClaw云端AI助手,阶跃AI基于OpenClaw架构推出的云端AI智能体 SongGeneration 2音乐生成模型,腾讯×清华开源·4B参数音乐生成大模型

SongGeneration 2音乐生成模型,腾讯×清华开源·4B参数音乐生成大模型 Gemini Embedding 2模型使用入口,谷歌推出的首个原生多模态嵌入模型

Gemini Embedding 2模型使用入口,谷歌推出的首个原生多模态嵌入模型 亚马逊全球网点布局大盘点(包括所有开店流程)

亚马逊全球网点布局大盘点(包括所有开店流程) eMAG全球3大国际站大盘点

eMAG全球3大国际站大盘点 美客多全球6大国际站大盘点

美客多全球6大国际站大盘点 OpenAI出大招:ChatGPT搜索功能免费开放,无需注册!

OpenAI出大招:ChatGPT搜索功能免费开放,无需注册! ProtGPS:麻省理工(MIT)和西湖大学共同开发的蛋白质语言模型

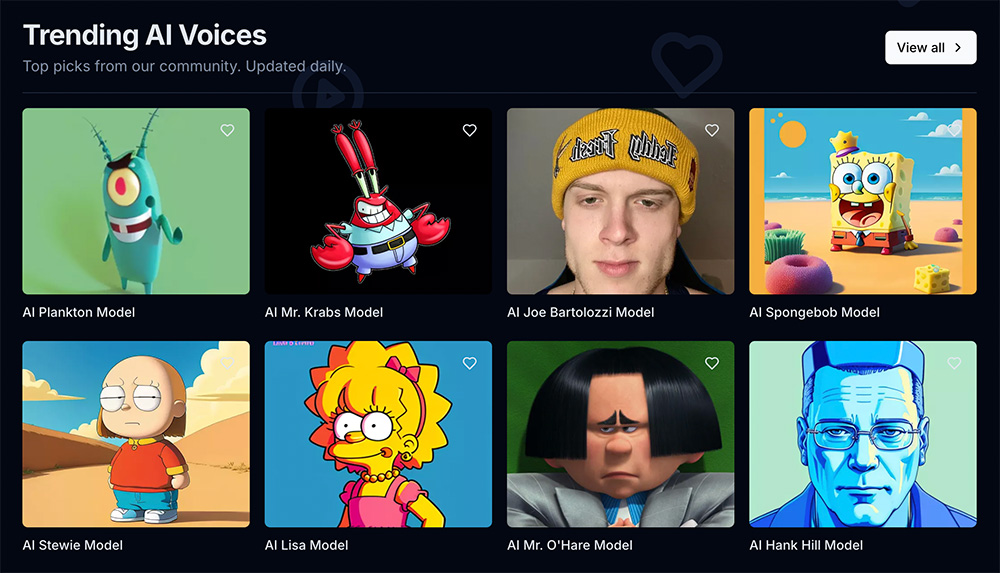

ProtGPS:麻省理工(MIT)和西湖大学共同开发的蛋白质语言模型 2025年ai声音克隆哪个最好 盘点值得推荐的AI声音克隆工具2025

2025年ai声音克隆哪个最好 盘点值得推荐的AI声音克隆工具2025 打工人开工的12款办公室ai工具

打工人开工的12款办公室ai工具 8款二次元AI绘画工具,一键生成动漫风插画,免费试用!

8款二次元AI绘画工具,一键生成动漫风插画,免费试用! 捏TA

捏TA Scispace

Scispace Inpodcast

Inpodcast Flux AI

Flux AI